Люди год читали статьи журналистов, не подозревая неладное. А стоило, ведь эти авторы — новый шедевр ИИ

Почти год люди читали статьи от журналистов-аналитиков, но больше не смогут насладиться их текстами. Выяснилось, что этих авторов просто не существует — они созданы нейросетью, и читатели этого даже не заметили, хотя, кажется, что «поломанная» внешность репортёров должна была их насторожить.

Издание The Daily Beast опубликовало расследование, авторы которого разоблачили личности около 19 журналистов, несколько месяцев писавших аналитические материалы о политике Ближнего Востока. Точнее сказать, корреспонденты выяснили, что их коллеги попросту не существуют.

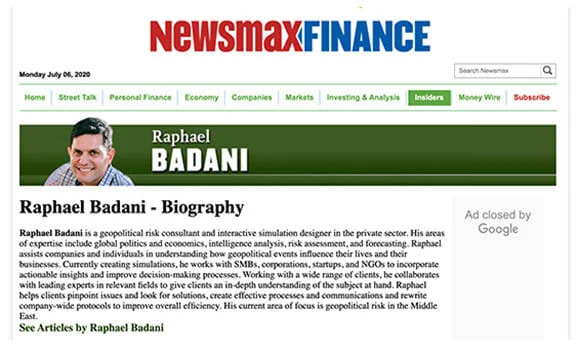

За это время материалы от авторов Рафаэля Бадани, Лин Гуен, Амани Шаан и других успели появиться в таких изданиях, как Asia Times, Washington Examiner, The National Interest и The Post Millennial. После разоблачения фейка редакторы некоторых из них извинились за ошибку, а другие молча удалили статьи со своих сайтов.

В афере участвовали мошенники, которые выдавали себя за экспертов и аналитиков, создавая себе виртуальные личности на основе фото реальных людей. Авторы даже завели своим фейкам профили в твиттере и LinkedIn.

Этот приём достаточно давно используется в Сети. Ничего не подозревающие пользователи становятся лицами поддельных новостей о COVID-19 или вдруг узнают, что сами погибли от этого вируса.

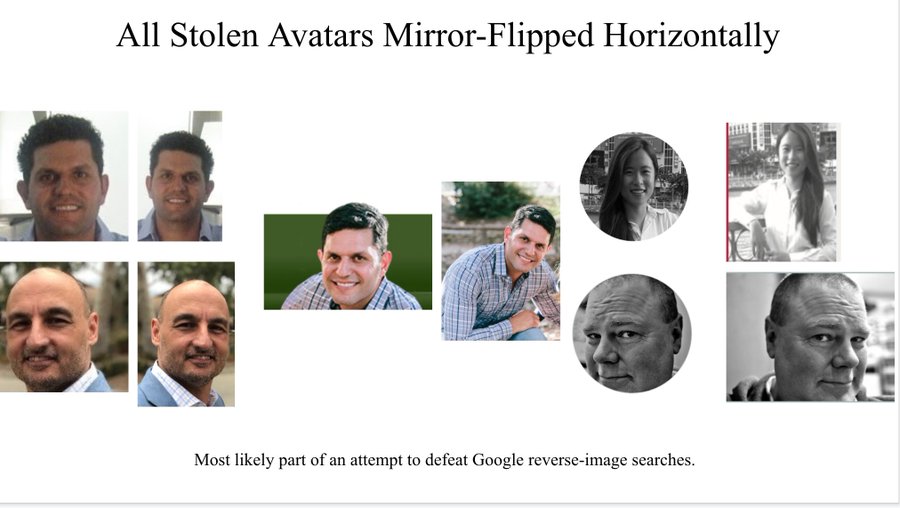

Один из журналистов-расследователей Адам Роунслей опубликовал тред о том, как злоумышленники разрабатывали фейки. Как минимум четверо из авторов использовали простое отзеркаливание чужих портретов.

Прежде всего: это украденные фото. Владельцы аккаунтов брали снимки реальных людей и выдавали их за кого-то другого без ведома или согласия владельцев. Мы нашли около четырёх из них. Вы может их рассмотреть. Они зеркалили их, скорее всего, чтобы обмануть поиск по изображениям.

Например, такой способ использовал Рафаэль Бадани, точнее, человек, прикрывавшийся этой поддельной личностью. Как утверждают журналисты, он украл фото у основателя стартапа в Сан-Диего Барри Дадона и просто отзеркалил их.

Однако другая часть команды авторов была полностью сгенерирована искусственным интеллектом. Что самое интересное — добыть фото этих несуществующих людей может любой, достаточно найти сайты, подобные ThisPersonDoesNotExist.com. Отследить первоисточник картинки невозможно, пишет The Verge.

Если внимательно присмотреться к фото «журналистов», созданных нейросетью, можно заметить несколько «глюков» в их внешности. К примеру, авторы The Daily Beast подробно рассмотрели снимок Джозеффа Лаббы — одного из авторов-фейков.

Некоторые из них, похоже, были сгенерированы искусственным интеллектом с использованием программного обеспечения для искусственного интеллекта, которое можно найти на ThisPersonDoesNotExist. Посмотрите на «Джозефа Лабба» в качестве примера.

Фальшивость Джозефа выдало его слишком гладкое ухо, на котором нет неровностей или выделенной мочки, как у обычных людей. Дантист доктор Кундель объяснил журналистам, что зубы героя фото тоже находятся не на своём месте.

Особенно бросается в глаза передняя часть верхней челюсти «журналиста» — зуба на ней всего три, хотя, по законам анатомии, их должно быть четыре. Так что, чтобы распознать фейк, достаточно внимательно посмотреть на лица с кадров.

Открытие журналистов произвело впечатление на обычных пользователей, которых удивили способности искусственного интеллекта.

Это пугает.

Очень проницательное наблюдение и находка!

Таким образом, неизвестные мошенники и настоящие журналисты-расследователи доказали, что современные технологии позволяют пользователям Сети не только стать анонимным интернет-троллем, но и выдать себя за уважаемого эксперта.

Но это уже не первый раз, когда нейросеть буквально заменила в каких-то сферах человека. Достаточно взглянуть на китайское ТВ, где выпуски новостей ведут не люди, а дикторы с программой вместо мозга.

Далеко в сфере разработки нейросетей продвинулись японцы — местные программисты создали целое стоковое хранилище со снимками несуществующих моделей. Если не знать историю истинного происхождения девушек, их невозможно отличить от реальных.