Алгоритм по чертам лица человека решает, хочется ли ему доверять. И борцы с расизмом недовольны его выводами

Исследователь показал алгоритм, анализирующий портреты, и от таких технологий многим людям становится не по себе. Учёных и их детище уже успели обвинить в расизме и дискриминации по внешности. Хотя многие критики, похоже, просто не поняли, что именно им показали.

Николя Бомард (Nicolas Baumard) — французский учёный, член группы исследователей во главе с Лу Сафра, известной специалисткой по когнитивной нейробиологии. Бомард, Сафра и их коллеги изучают то, как головной мозг человека воспринимает визуальную информацию — в том числе изображения других людей.

В среду, 23 сентября, Бомард решил поделиться со своими подписчиками результатами исследования.

Новая публикация вышла. «Отслеживание исторических изменений в восприятии надёжности и доверия с применением машинного обучения в изучении черт лица на картинах».

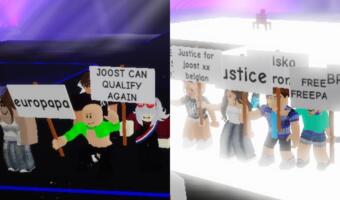

Проще говоря, учёные научили машину анализировать портреты исторических личностей, чтобы проверить, кто из них изображён внушающим доверие. Алгоритм размечает черты лица каждого человека и показывает степень «надёжности человека» — вернее, того, насколько надёжным и вызывающим доверие его считали художник и зрители.

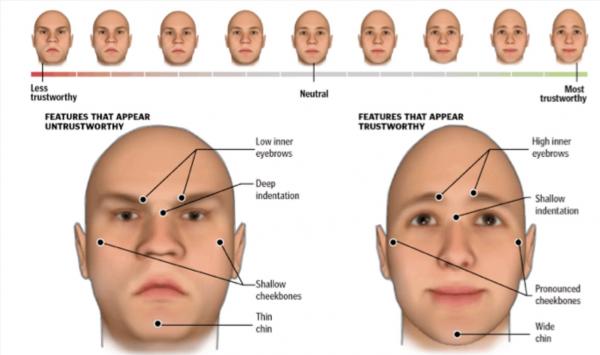

Исследователи сформировали целый список черт лица, связанных с восприятием доверия.

Основываясь на последних достижениях в области когнитивной социологии, мы разработали алгоритм для автоматического генерирования оценок надёжности для черт лица (улыбка, брови и т. д.).

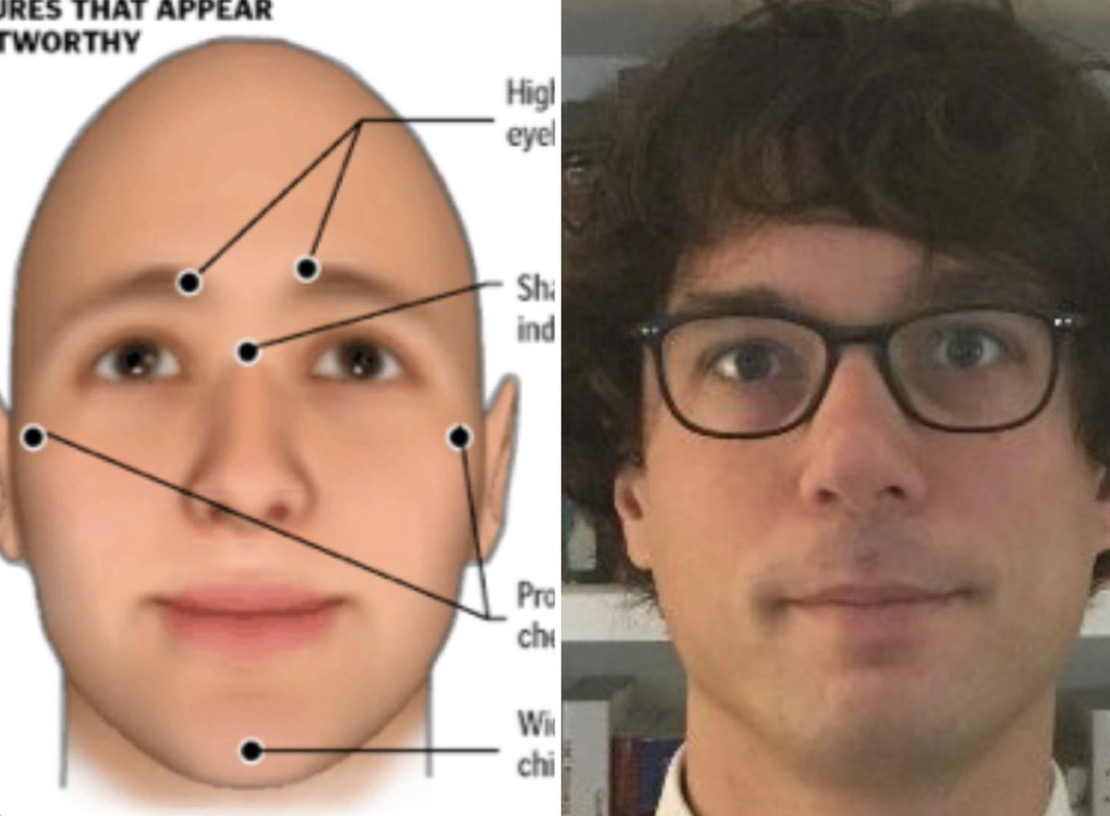

В треде, посвящённом исследованию, учёный показал на примере компьютерных моделей, как внешность людей влияет на их имидж. Судя по изображению, гораздо больше доверия вызывают обладатели приподнятых бровей и уголков губ. Среди «признаков ненадёжности» оказались глубоко посаженные глаза и нос, не очень заметные скулы и узкий подбородок.

Вскоре на твиты учёного обратили внимание пользователи твиттера, которых подобный подход расстраивает и возмущает. Так, блогерша по имени Бриттани обвинила создателей алгоритма в расизме, и её твит набрал больше 160 тысяч лайков.

Вот так и выглядит расизм в технологиях и компьютерных науках. Хочу, чтобы вы знали.

Критики Бомарда решили, что учёный буквально показывает, каким людям можно доверять, а каким нет.

Даже если забыть о расизме, как можно заявлять, что структура лица человека говорит о том, насколько ему можно доверять???

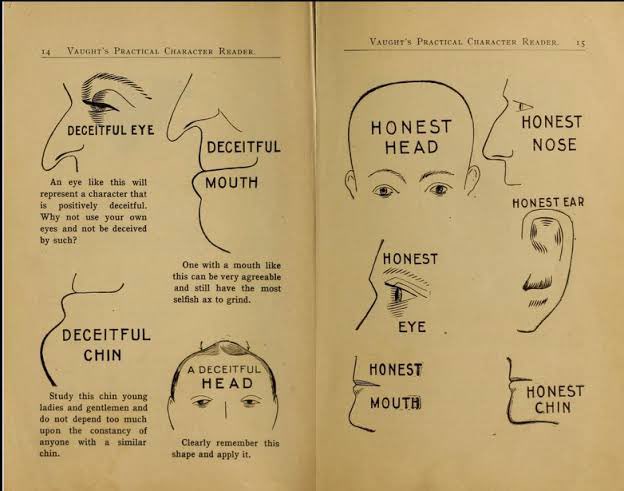

Подобный подход напомнил Бриттани и её подписчикам о физиогномике и френологии — псевдонауках о том, что психика человека связана с чертами его лица или строением его черепа. Именно френологию использовали работорговцы, чтобы оправдать существование рабства — ведь у темнокожих людей форма головы выглядела не так, как у европейцев.

Они просто обновили вот это.

Комментаторов особенно смутило то, что у человека, который, согласно исследованию, не выглядит надёжно, очень широкий нос (хотя о форме носа учёный ничего не писал). У многих афроамериканцев носы шире, чем у их белых сограждан, поэтому неудивительно, что иллюстрация задела их чувства.

На подписях даже не упоминается то, как они поменяли форму носа. Широкие и плоские носы не вызывают доверия? Честно, меня просто тошнит от этого.

Они просто взяли и добавили широкий нос????

Да уж. Его отлично видно, но они решили, что смогут избежать скандалов, если просто не подпишут его.

Кроме того, ещё одна пользовательница твиттера обратила внимание на то, что сам Бомард похож на модель, которую алгоритм считает вызывающей доверие. Девушка предположила, что своей работой учёный закрепляет привилегии белых мужчин, в том числе и свои собственные.

Именно так выглядит расизм в технологиях. Белые мужчины создают технологии, используя френологию и расистские теории, согласно которым они заслуживают власти и привилегий.

Впрочем, некоторые комментаторы уверены: Бомарда не так поняли.

Эм… Кто-то тут вообще прочитал его тред? Это разработка о том, как люди воспринимают надёжность друг друга (в том числе и со стереотипами), и её использовали, чтобы проанализировать картины и понять, как важно в те времена было вызывать доверие у окружающих. Они же не говорят, что просто научились измерять надёжность людей.

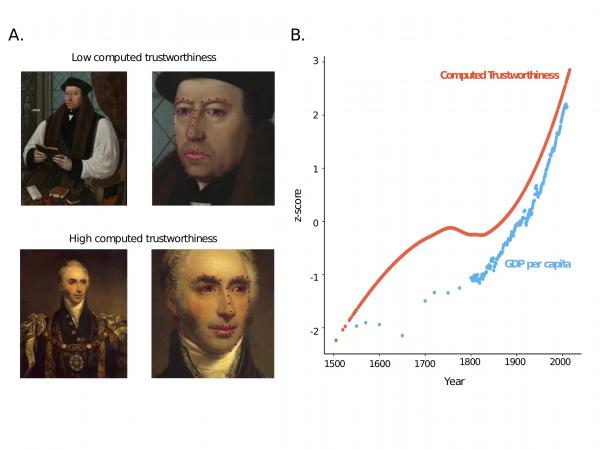

Действительно, в своих твитах Бомард описал, как именно применялся алгоритм в приведённом им исследовании. Учёные хотели показать, как в разные эпохи художники стремились продемонстрировать те или иные черты характера своих моделей.

Мы использовали его на исторических портретах. В портрете можно отобразить все качества: достоинство, силу, богатство, молодость, а также надёжность. Количественная оценка надёжности показывает, насколько важно в обществе выглядеть приятно и надёжно.

Чтобы проиллюстрировать свою точку зрения, Бомард показал, насколько меняется портрет Рене Декарта, если добавить к нему улыбку.

Например, знаменитый портрет Декарта мог выглядеть совсем по-другому.

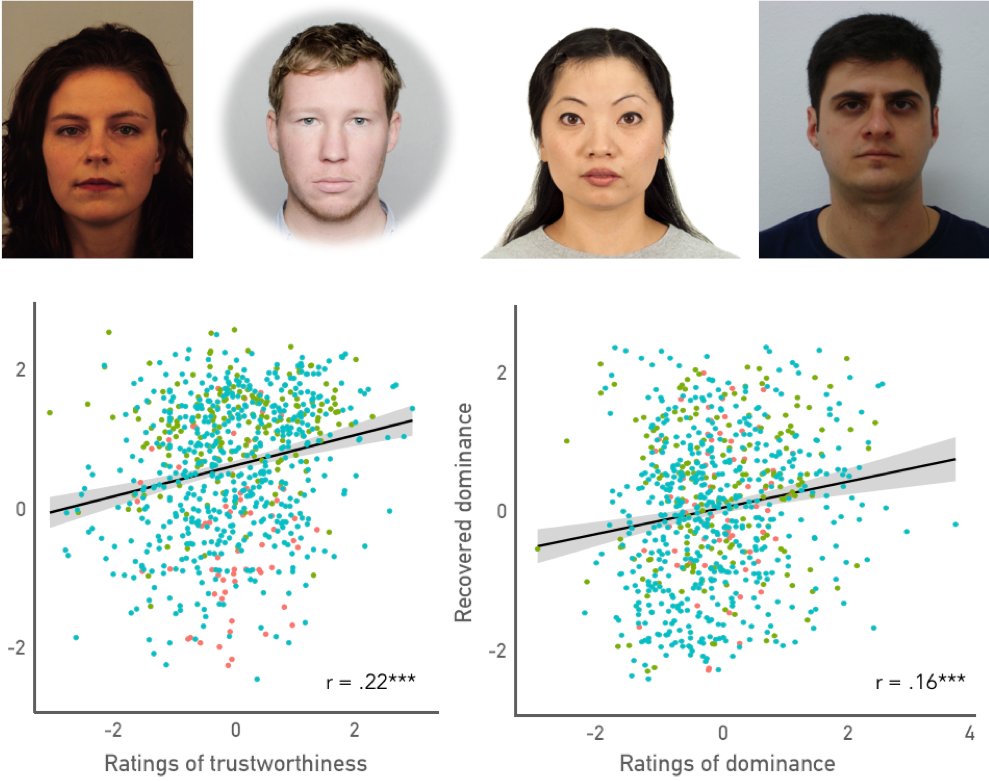

Исследователь рассказал, что алгоритм тестировали на целой базе снимков со всего мира, и целью учёных было как раз научить машину реагировать на человеческие лица так, как это делали бы настоящие люди.

Чтобы оценить возможности нашей модели, мы проверили её достоверность на четырёх базах данных с настоящими лицами, оцененными реальными людьми. Мы продемонстрировали, что алгоритм даёт рейтинги, которые совпадают с рейтингами, полученными участниками в базах данных.

Мы удостоверились, что алгоритм подвержен тем же предубеждениям, что и люди, то есть оценивает молодые, женственные и счастливые лица как заслуживающие доверия.

Поэтому, хотя возмущение Бриттани и её сторонников можно понять, им стоит винить в произошедшем не исследователей, а человечество в целом. Ведь алгоритм основан именно на мнениях людей и отображает то, как средний человек воспринимает себе подобных.

Люди действительно часто судят друг друга по внешности, и это может приводить к проблемам. Именно поэтому за бодипозитив выступают не только женщины, но и мужчины. Ведь им есть что рассказать о стереотипах и мужском теле.

Что касается закрепления предубеждений, этим грешат не только технологии, но и искусство. Так, пользователи соцсетей уже обращали внимание на то, как режиссёры показывают сильный характер своих азиатских героинь. Оказывается, для этого достаточно пряди волос.