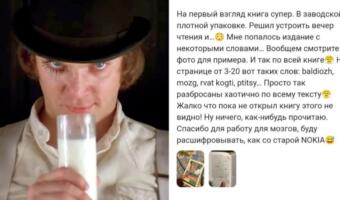

Двое студентов продавали на Reddit нюдсы несуществующей девушки по имени Клаудия, сгенерированные нейросетью Stable Diffusion. Авторам аккаунта удалось обмануть покупателей фото пышногрудой брюнетки и заработать 100 долларов (примерно 8 000 рублей).

В Сети распространилась история 19-летней девушки с никнеймом Клаудия (u/Cl4ud14), сгенерированной искусственным интеллектом, которая продавала нюдсы на Reddit. Юзерша предлагала отправить обнажённые фото тем, кто придёт к ней в личку. На приветственном фото, которое запутало реддиторов, Клаудиа выглядела как брюнетка с серыми глазами, пышной грудью и нюдовым мейкапом.

Сегодня чувствую себя красивой.

Мечты желающих купить нюдсы рухнули, когда выяснилось, что фото девушки – работа нейросети Stable Diffusion. Оказалось, что аккаунт u/Cl4ud14 зарегистрировали два студента. Авторы фото решили проверить, сможет ли ИИ обмануть интернет-пользователей. Студенты рассказали журналу Rolling Stone, что заработали на нюдсах Клаудии 100 долларов (около 8 156 рублей) прежде, чем реддиторы вывели их на чистую воду.

Создавая Клаудию, реддиторы попросили ИИ сгенерировать селфи девушки в её доме «без макияжа, с чёрными волосами, волосами до плеч, простым фоном, прямыми волосами и чёлкой».

Надеюсь, я выгляжу желанной для тебя.

Чтобы заинтересовать клиентов, студенты публиковали откровенные посты об экспериментах Клаудии в сексе.

Наслаждайся мною.

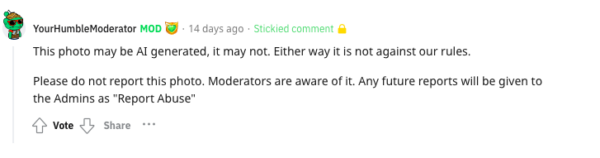

После десятков комментариев с комплиментами в адрес Клаудии реддиторы предположили, что перед ними фото от ИИ. Интернет-пользователи попросили показать им руки модели. Ранее Medialeaks рассказывал, как нейросети генерируют людей с шестью пальцами, вызывая эффект зловещей долины. На аккаунт обратили внимание и модераторы платформы.

Пожалуйста, не репостите это фото. Модераторы знают о нём. Любые репосты будут считаться нарушением.

Разработчики Stable Diffusion запрещают пользователям создавать непристойные изображения порнографического характера, но из-за доступности ИИ для каждого не могут отследить весь контент.

В другом материале Medialeaks можно увидеть девушек от нейросети, нарисованных на основе имён.

Нужен надёжный помощник по ремонту? Вам сюда.