Инженеры Кембриджского университета утверждают, что их эксперимент — аналог эволюции для машин.

Британские программисты на основе робота UR5 компании Universal Robots создали своего рода «робота-маму», которая умеет собирать из конструктора других, маленьких и примитивных роботов. В этом не было бы ничего нового, если бы «робот-мама» не обладала важной особенностью: умением оценивать своих «детей» и изменять технологию их создания, основываясь на своих наблюдениях. Статья об этом опубликована в журнале Ruplic Library of Science.

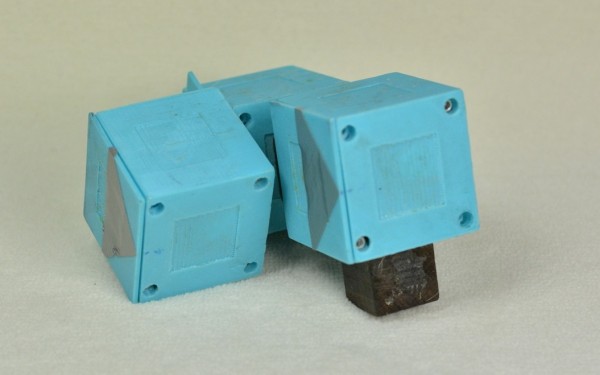

UR5 состоит из процессора, манипулятора и камеры для наблюдения за окружающей средой. Для создания «детей» используются кубики со встроенными электромоторами и примитивными блоками управления. Собрав одного «ребенка», UR5 наблюдает за его движением, склеивает нового, добавляя детали, опять смотрит, опять переделывает — и так далее. Сколько итераций маленьких роботов всего может быть создано, в статье не говорится.

По версии создателей «робота-мамы», они запустили аналог эволюции для машин.

«Естественный отбор, по сути, это повторяющаяся связка «воспроизводство — оценка». Именно этим и занимается наш робот. Мы можем наблюдать за развитием вида и диверсификацией», — говорит Фумия Лида, ведущий исследователь проекта.

Примерно в то же время, когда в прокат вышла очередная серия франшизы «Терминатор», в основе которой лежит антиутопия о создании искусственного интеллекта и восстании машин, дискуссия о перспективах робототехники обострилась. В конце июля группа предпринимателей и ученых, в том числе Стивен Хокинг, Илон Маск, Стив Возняк и Ноам Хомски, выступила с открытым обращением к военным с призывам не начинать гонку оборонительных систем с искусственным интеллектом. По мнению подписантов, нельзя исключать, что рано или поздно оружие, способное к автономным действиям и самообучению, повернется против людей. И до тех пор, пока в обратном нет уверенности, не стоит подключать искусственный интеллект к оборонной продукции.

Ранее основатель компаний Tesla и Space X Илон Маск выделил около $10 млн на исследование потенциальных угроз, которые могут исходить от искусственного интеллекта, и поиск способов эти угрозы отвратить.