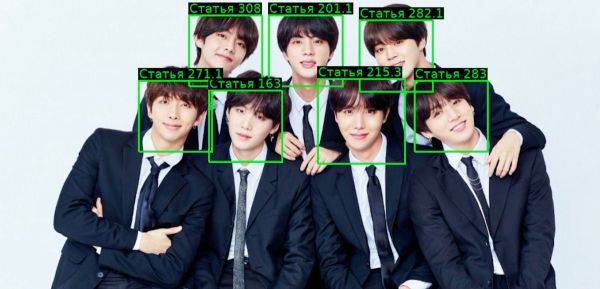

Алгоритм показал, за что посадят парней из BTS. Это нейроправосудие, и вам грозит то же самое (а то и похуже)

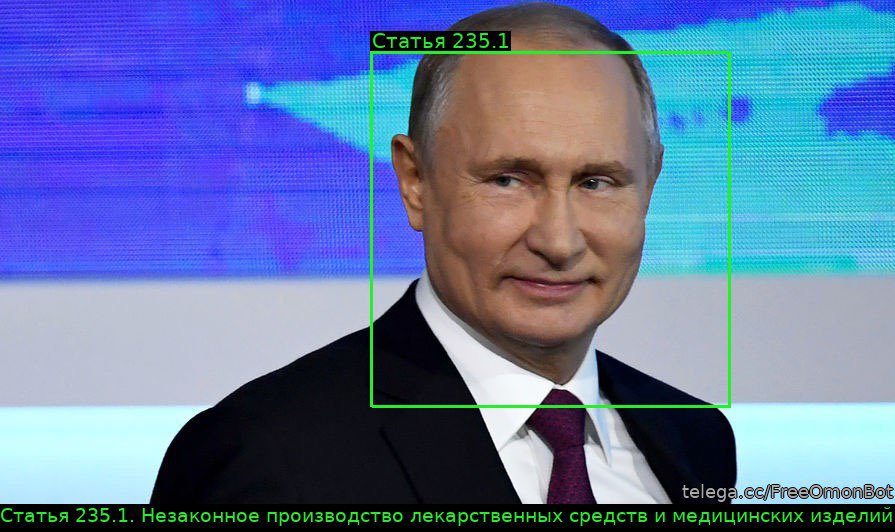

Пользователи соцсетей устремились в телеграм, чтобы узнать по какой статье их посадят. Алгоритм успешно распознаёт лица и предлагает каждому по приговору. И под его пристальный взгляд попали не только простые смертные, но и такие личности, как участники группы BTS и даже Владимир Путин. В общем, был бы человек, а статья найдётся.

В начале августа 2019 года в телеграме появился бот FreeOmon, который добавляет на любые изображения сотрудников ОМОН и бойцов Росгвардии.

Уважаемые котаны, просьба разойтись и не мешать проходу других котанов.

Автором задумки оказался известный твиттерский блогер Анатолий Капустин (анатолий ноготочки? ).

Всем привет!

Меня зовут Толя Капустин, и это я сделал бота с ОМОНом.

Всего за два дня ботом воспользовались больше 82к человек, обработано больше 470к фотографий

Это какие-то невероятные цифры, я такого не ожидал!

К сообщению с раскрытием анонимности была прикреплена ссылка для пожертвований интернет-СМИ «Медиазона», освещающему политические и уголовные процессы, незаконные задержания, полицейский произвол и так далее.

В четверг, 19 сентября, в боте появилось обновление. Вот так его аннонсировал Анатолий у себя в твиттере:

Смотрите, какой клёвый апдейт мы выпустили в ОМОН-боте!

Вы загружаете фотографию, а он вам показывает, по какой статье вас могут посадить в России 🙂

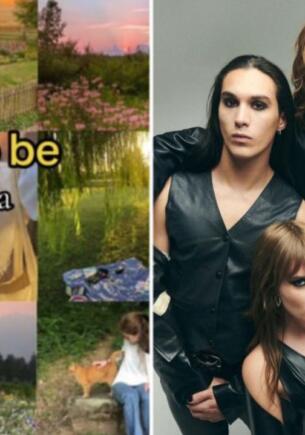

Ну а сам бот разослал всем своим собеседникам сообщение про «нейроправосудие». И в качестве иллюстрации использовал не кого-нибудь, а участников k-pop-группы BTS.

По всей Москве понатыканы камеры, которые распознают вас сотню раз на дню.

Скоро даже проезд в метро можно будет оплатить, посмотрев в одну из них.

От приватности не осталось ничего, а значит пошла пора пойти дальше и дать машине не только распознать тебя, но и осудить!

Все так же загружайте фотографии в бота, а наш алгоритм будет находить на них лицо и показывать, по какой статье вас могут посадить.Да настанет НЕЙРОПРАВОСУДИЕ!

За одно утро работы бот обработал почти 10 тысяч фотографий. Пользователи соцсетей бросились выяснять (в шутку, конечно), по каким статьям могут привлечь их и их близких. А потом перешли и на других людей.

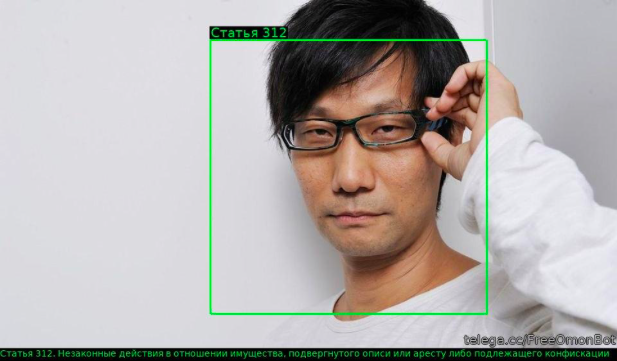

Гениальный геймдизайнер Хидео Кодзима уже получил по заслугам.

ГЕНИЙ.

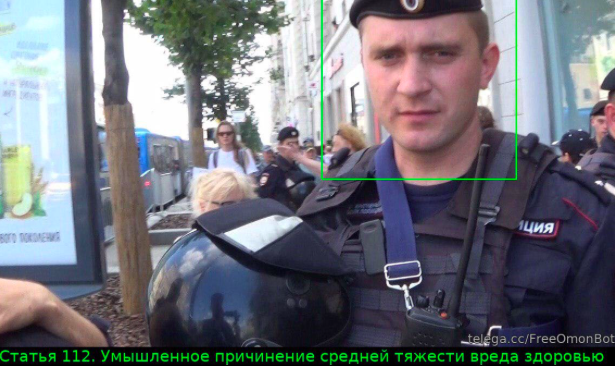

Вскоре выяснилось, что бот Анатолия явно что-то знает.

Толя! Поясни как так вышло, что твой бот работает лучше чем российское правосудие?

На фото Александр Журавлёв, сломавший мне ногу перед акцией 27 июля!

Причём алгоритму не чуждо не только правосудие, но и искусство.

Не знаю, кто это сделал, но этот пост выглядит, как обложка музыкального альбома!

Сам механизм использования бота не изменился. Достаточно постучаться к нему по ссылке, отправить какую-нибудь картинку, и в ответ он пришлёт её дополненную версию. Алгоритм действительно довольно легко находит на изображении лица — в большинстве случаев. А затем к каждому из них добавляется рамочка с номером статьи. Внизу новой картинки можно почитать, за что именно вас посадят.

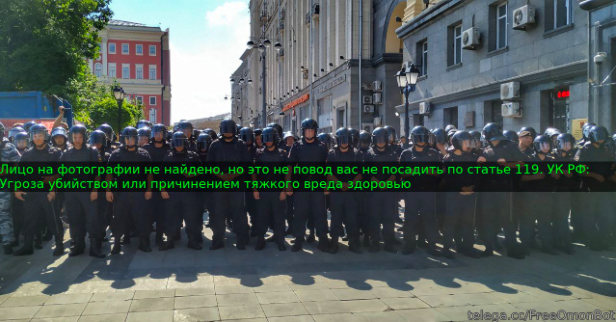

Кстати, если бот не распознаёт лицо на фотографии, он не отчаивается. Без приговора не уйдёт никто.

Теперь я нисколько не сомневаюсь в том, что мой пёс может обглодать кому-нибудь лицо.

И не спешите радоваться, если вам выпало что-то несерьёзное: числа выпадают случайным образом, и в следующий раз бот запросто может приписать вам убийство, совершённое с особой жестокостью. Или и того хуже — применение насилия к представителю власти (именно по этой статье вынесли приговор Павлу Устинову, за освобождение которого сейчас выступают знаменитости по всей стране).

Кстати, если вы думаете, что это всё, на что способны технологии, то очень ошибаетесь. В наши дни нейросети могут очень многое. Например, превратить вас в аниме. И от этого сервиса очень сложно оторваться: ведь получается то милота, то крипота.