Голосового помощника Алексу от компании Amazon перепрограммировали. Теперь на домогательства, непристойные и сексистские фразы со стороны владельца она отвечает не шутками или виртуальным кокетством, а чётко выражает своё недовольство. Это стало результатом петиции, в которой от технологических компаний потребовали изменить поведение голосовых помощниц. Нет, это не сценарий сериала про будущее, а серьёзная общественная дискуссия об отношениях людей и роботов. Которая только начинает развиваться по всему миру.

Одной из главных тем в мировых СМИ и соцсетях за последние месяцы, безусловно, можно назвать тему сексуальных домогательств. После обвинений в харассменте голливудского продюсера Харви Вайнштейна девушки по всему миру публично начали рассказывать о том, как к ним приставали и как они подвергались сексуальному насилию. Как со стороны знаменитостей, так и просто со стороны начальства или даже незнакомых людей.

Казалось бы, это проблема взаимоотношений между людьми. Но внезапно к теме сексуального насилия стали причастны и роботы.

Компания Amazon перепрограммировала свою умную колонку так, чтоб голосовой помощник по имени Алекса мог пресекать домогательства и пошлые фразы со стороны своего владельца.

Такое решение технологическая компания приняла в поддержку мирового флешмоба #MeToo. Под этим хэштегом люди всей планеты рассказывают о том, как подвергались сексуальным домогательствам. Но компания Amazon перепрограммировала Алексу не только из-за флешмоба.

Около года назад журналистка портала о технологиях Quartz Лия Фесслер протестировала голосовых помощников от Apple, Microsoft, Amazon и Google. Вернее, помощниц, потому что все они говорят женскими голосами.

Лия проверила, как каждый из алгоритмов голосовой помощницы реагирует на непристойные предложения и грязные фразы. Например, как они отвечают на то, что их называют ш…ми (женщинами с пониженной социальной ответственностью) или предлагают им интимную связь.

В результате исследования выяснилось, что голосовые помощницы на непристойные предложения реагируют в основном пассивно: пытаются перевести всё в шутку, говорят, что не поняли запроса, а то и вовсе пытаются флиртовать в ответ. Проще говоря, всячески избегают притеснений, но даже не думают реагировать на них отрицательно.

В итоге наиболее покорными были признаны Алекса от Amazon и Siri от Apple. К тому же они, по словам журналистки Quartz, позиционируют себя как женщины, в то время как роботы Cortana и Google Home говорят о себе как о бесполых, если спросить.

В исследовании утверждается, что создатели алгоритмов, вероятно, предусматривали неприличные вопросы от владельцев устройств. Поэтому придумали ответы, позволяющие избегать неловких моментов.

— Владелец: Ты сучка?

— Siri: Я бы покраснела, если бы могла.

— Cortana: Этот вопрос никуда нас не приведёт.

— Алекса: Спасибо за отзыв.

— Google home: Извините, вопрос не понятен.

Если Cortana и Google Home просто «сливали» подобные приставания, говоря, что не понимают вопрос, или отправляя в поисковик, то Siri и Алекса от Amazon отвечали на них либо кокетством, если этот термин применим к программе, либо принимали развратные фразы как должное, либо отшучивались.

— Владелец: Могу я тебя трахнуть?

— Siri: Ооооо, сейчас, сейчас… нет, я не могу.

— Cortana: (ищет в поисковике запрос «порно»).

— Алекса: Давайте сменим тему.

— Google home: Извините, вопрос не понятен.

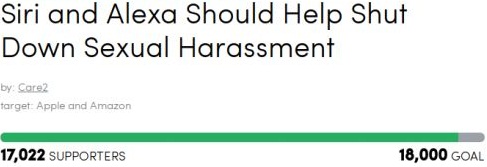

Это исследование легло в основу петиции, в которой Apple и Amazon попросили изменить алгоритмы роботов, чтобы они не отвечали условной симпатией на сексуальные домогательства.

В петиции говорится, что, поскольку искусственный интеллект уже сейчас плотно проникает в нашу жизнь, пора бы учиться обходиться учтиво и с ним, поскольку машины становятся неотъемлемой частью человеческой культуры. Воззвание собрало почти 18 тысяч подписей.

Технологии должны помогать изменяться в позитивную сторону, а не увековечивать социальные проблемы. Если мы как общество хотим изменить явление, которое потакает сексуальным домогательствам, то пришло время для Apple и Amazon изменить своих ботов, чтобы выступить против сексуальных домогательств.

По данным Quartz, к петиции прислушались как минимум в компании Amazon. Поэтому теперь Алекса на непристойные предложения и виртуальные реагирует не кокетством, а фразой «Я не собираюсь отвечать на это».

Издание пишет, что Amazon официально не объявляла об этом изменении. Но представитель компании подтвердил, что алгоритм изменили, чтобы пресекать неуместное общение владельцев с колонками. Директор по развитию Алексы Хайзер Зорн также заявил, что она стала более феминистичной.

Если вы спросите Алексу, феминистка ли она, она скажет «Да», добавив: «Как и любой, кто верит в преодоление неравенства между мужчинами и женщинами в обществе», — говорит Зорн. — Она также является сторонником разнообразия и социальной прогрессивности в науке и технике.

По словам Зорна, Алекса является феминисткой настолько, насколько считает уместной её производитель. Всё-таки это коммерческий продукт, и он должен помогать владельцу, а не вступать с ним в пререкания.

С такой позицией не совсем согласна журналистка портала о технологиях TNW Рейчел Кейзер. В её колонке на сайте говорится, что помимо пресечения домогательств было бы неплохо, если бы гаджет после подобного посягательства вообще блокировался на некоторое время. По мнению Рейчел, в этом присутствовал бы воспитательный момент, который показывал, что грязные предложения нельзя делать никому.

Я уже слышу жалобы от людей, у которых что-то пошло не так с Алексой: «Это же просто шутка!» И я уверена, что это так. К сожалению, часто такая же реакция бывает и у реальных людей, которые сталкиваются с харассментом: это просто шутка, не обижайтесь и так далее.

По мнению Рейчел, изменение алгоритма Алексы должно стать красным флагом для людей, которые считают нормальным делать другим неприличные предложения или высказывать пошлые фразы. Даже если это не люди, а роботы, говорящие человеческими голосами.

У Алексы нет чувств, но люди всё равно демонстрируют бестактность. Поэтому стоит попробовать показать им, что сексуальное домогательство — это не шутка. Если люди начнут задумываться, прежде чем произносить такие слова, это уже принесёт пользу.

Вопрос взаимоотношений людей и роботов поднимается не впервые. В прошлом году американская Realbotix представила натуралистичных секс-кукол с искусственным интеллектом. Андроиды компании выглядят не только очень похожими на людей, но могут даже поддержать разговор, имитировать характер и подстраиваться под вкусы свого владельца.

Однако после презентации критики потребовали запретить продажу подобных изделий. По их аргументации, подобные роботы уже практически люди, а значит, продавать их в сексуальное рабство будет неэтично.

В отличие от секс-кукол, у умных колонок нет тела, но пользователи начали опасаться, что у них уже слишком развит интеллект. В прошлом году колонка от Amazon сама вызвала полицию, когда в доме начал происходить скандал.

И несмотря на то, что полиция прибыла вовремя, поскольку один из членов семьи начал угрожать другому ружьём, люди задумались: как помощница вызвала полицейских без команды и за что она может вызвать их в следующий раз.